ChatGPT rend-il idiot ?

Ce que révèle vraiment l'étude du MIT

IA

Sylvain Morizet

6/24/20254 min read

L’intelligence artificielle générative s’invite chaque jour un peu plus dans nos vies. Elle révolutionne la création de contenus, simplifie l'accès à l'information, et déclenche au passage son lot de fantasmes et d'inquiétudes. Dernier exemple en date : une étude du MIT, abondamment relayée, censée démontrer que ChatGPT… nous abrutit.

Au-delà du buzz et des raccourcis médiatiques, que dit réellement cette étude ? Et surtout, quelle réflexion collective devons-nous engager sur l’usage de ces technologies ?

Une étude sérieuse… mais à manier avec précaution

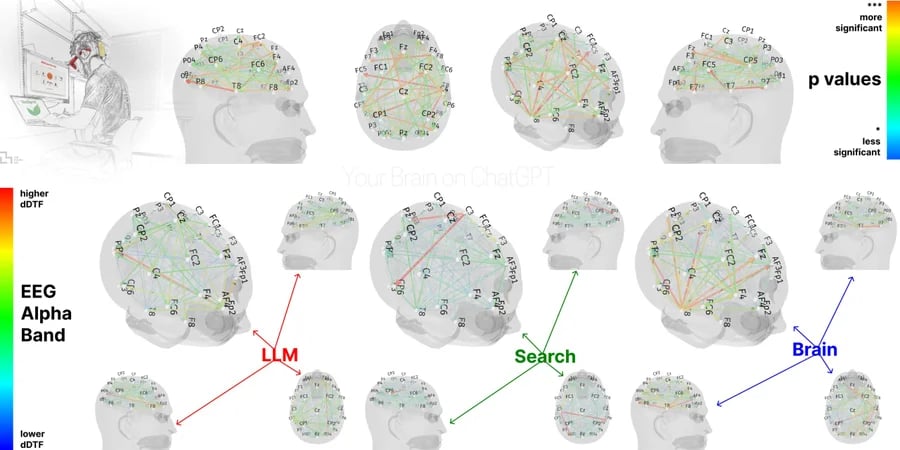

L’étude intitulée Your Brain on ChatGPT, conduite par le MIT et prépubliée sur arXiv, s’intéresse à l'impact cognitif de l'IA générative dans une tâche d’écriture. Méthodologie simple mais efficace : 54 volontaires répartis en trois groupes, équipés d’électroencéphalogrammes pour mesurer leur activité cérébrale.

Les consignes :

Groupe 1 : rédiger un texte sans aide extérieure.

Groupe 2 : utiliser Google comme source d'information.

Groupe 3 : s'appuyer sur ChatGPT.

Constat sans surprise : plus l'outil facilite la tâche, moins le cerveau s'active. Ceux sans assistance mobilisent leur mémoire, leur créativité, leur logique, au prix d’un texte parfois médiocre. Les utilisateurs de Google s'appuient sur la recherche pour structurer leur propos. Quant au groupe ChatGPT, ils produisent des textes souvent plus fluides, mais leur activité cérébrale et surtout leur sentiment de "posséder" leur travail s'effondrent.

Autrement dit : IA générative = moins d'effort, moins d'appropriation, moins de mémorisation.

Mais peut-on en déduire que ChatGPT rend idiot ?

La mauvaise interprétation : le raccourci sensationnaliste

Beaucoup l'ont fait, sur les réseaux sociaux et dans les médias généralistes : "ChatGPT abrutit la population", "Interdisons l'IA à l'école", "Les jeunes ne sauront plus réfléchir par eux-mêmes"...

C’est une lecture simpliste et biaisée de l’étude. Comparons :

➡️ Avec la même logique, on pourrait dire que les livres rendent idiots, puisqu’ils évitent de réinventer le savoir.

➡️ Ou que la voiture affaiblit le corps, car elle supprime l'effort physique du déplacement.

C’est oublier l’essentiel : ce n'est pas l'outil qui est en cause, mais la manière dont on s'en sert.

Ce que révèle réellement l'étude : un enjeu d’éducation et de maîtrise

Cette étude du MIT ne remet pas en question l'intérêt de l'IA, mais souligne un phénomène connu : plus un outil est performant, plus il déplace l'effort. La vraie question est donc : comment équilibrer gain d'efficacité et stimulation cognitive ?

D'autant plus que le phénomène n'est pas nouveau :

Dans les années 90, Jean Tirole évoquait déjà l'émergence d'une "fracture cognitive", où seuls ceux qui maîtrisent les outils numériques renforcent leur intelligence, quand d'autres se contentent d'un usage passif.

L'industrialisation de la musique ou de la vidéo a produit des effets similaires : plus d'accès, mais souvent au prix d’une dégradation qualitative (cf. musique compressée, séries standardisées par les algorithmes).

Dans l’éducation, les calculatrices, Internet ou Wikipédia ont suscité les mêmes peurs… et les mêmes débats.

Avec l'IA générative, nous entrons dans une nouvelle phase : celle où l'outil peut produire à notre place, non plus seulement nous informer.

Deux scénarios : idiotie assistée ou intelligence augmentée

L’étude du MIT ouvre deux chemins :

Un usage passif et paresseux, où l'IA rédige, décide, résume à notre place. Résultat : déresponsabilisation, perte d’appropriation, affaiblissement cognitif.

Un usage actif et critique, où l'IA devient catalyseur d'idées, outil d'exploration, assistant créatif, mais jamais substitut à la réflexion personnelle.

Entre ces deux scénarios se joue l'avenir de l'éducation, de la recherche et, plus largement, de notre capacité collective à penser par nous-mêmes.

L'urgence : repenser la formation et les exigences

L’IA générative ne doit ni être diabolisée, ni banalisée. Elle impose :

✔️ Une formation massive à son usage raisonné : apprendre à interagir avec l'IA, à vérifier, à contextualiser, à approfondir.

✔️ Une réévaluation des standards éducatifs : intégrer l'IA en augmentant les niveaux d'exigence, pas en les abaissant.

✔️ Des modes d'évaluation adaptés : favoriser les épreuves en présentiel, sur papier, sans IA, pour mesurer la réflexion autonome.

✔️ Une vigilance éthique, pour éviter que l'IA ne devienne un simple cache-misère des lacunes de fond.

Conclusion : l'IA, levier ou piège ?

L'étude du MIT ne dit pas que ChatGPT rend idiot. Elle révèle qu’un usage non maîtrisé peut réduire l'effort intellectuel et l’appropriation du savoir. C'est un signal d'alerte, pas un réquisitoire.

Reste à savoir quelle IA nous voulons :

Une IA qui nous simplifie la vie au prix de notre autonomie cognitive ?

Ou une IA qui nous pousse à aller plus loin, plus vite, plus profondément… sans jamais se substituer à notre esprit critique ?

L'intelligence artificielle ne rend idiot que celui qui l'utilise sans réfléchir. À nous de décider dans quel camp nous voulons être.

Réseaux Sociaux & Cie

Rejoignez-nous sur les réseaux sociaux suivants

RESTONS EN CONTACT

© 2024. All rights reserved.